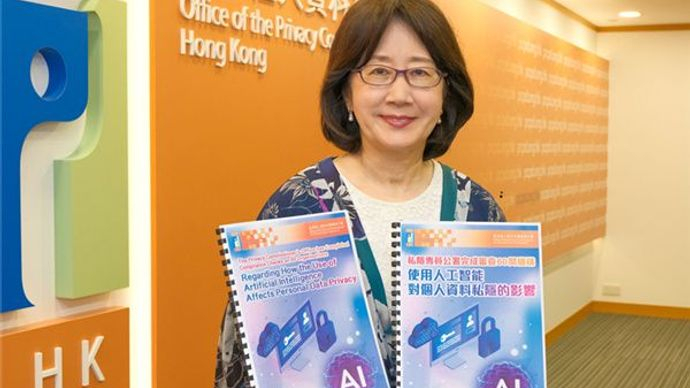

私隐专员公署完成审查60间机构。(网页图片)

随着人工智能应用日渐普及,越来越多的机构于业务营运中使用人工智能;然而,人工智能所带来的私隐及安全风险亦不容忽视。个人资料私隐专员公署今日(8日)宣布,完成审查60间机构使用人工智能(AI)的情况,并发表报告。公署在是次循规审查过程中未有发现有违反《个人资料(私隐)条例》(《私隐条例》)相关规定的情况。

公署表示,是次审查涉及60间本地机构,并涵盖不同行业,包括电讯、银行及金融、保险、美容、零售、运输、教育、医疗、公用事业、社会服务及政府部门,以了解它们在使用人工智能时收集、使用及处理个人资料有否遵从《个人资料(私隐)条例》(《私隐条例》)的相关规定。同时,是次审查亦审视了该些机构就公署于2024年发布的《人工智能(AI):个人资料保障模范框架》(《模范框架》)所提供的建议和最佳行事常规的实施情况,以及对于使用人工智能的管治情况。根据审查结果,其中48间机构在日常营运中使用人工智能,较去年循规审查上升了5%,当中42间机构使用人工智能已超过一年。

私隐专员钟丽玲表示,审查的机构在透过人工智能系统收集及/或使用个人资料时均采取了相应的保安措施保障数据安全,并在决策过程中采取较高程度的人为监督,以减低人工智能出错的风险。另外,绝大部分机构均有制定资料外泄事故应变计划应对突发事故,更有部分机构的应变计划涵盖专门针对人工智能相关的资料外泄事故。

公署亦希望透过是次循规审查,向所有开发或使用人工智能的机构提供建议措施,包括制定开发或使用人工智能策略及设立人工智能内部管治架构,并为所有有关人员提供足够的培训等。此外,机构亦应制定人工智能事故应变计划,以监察及应对可能意外发生的事故等。

香港新闻社

有视界·有世界